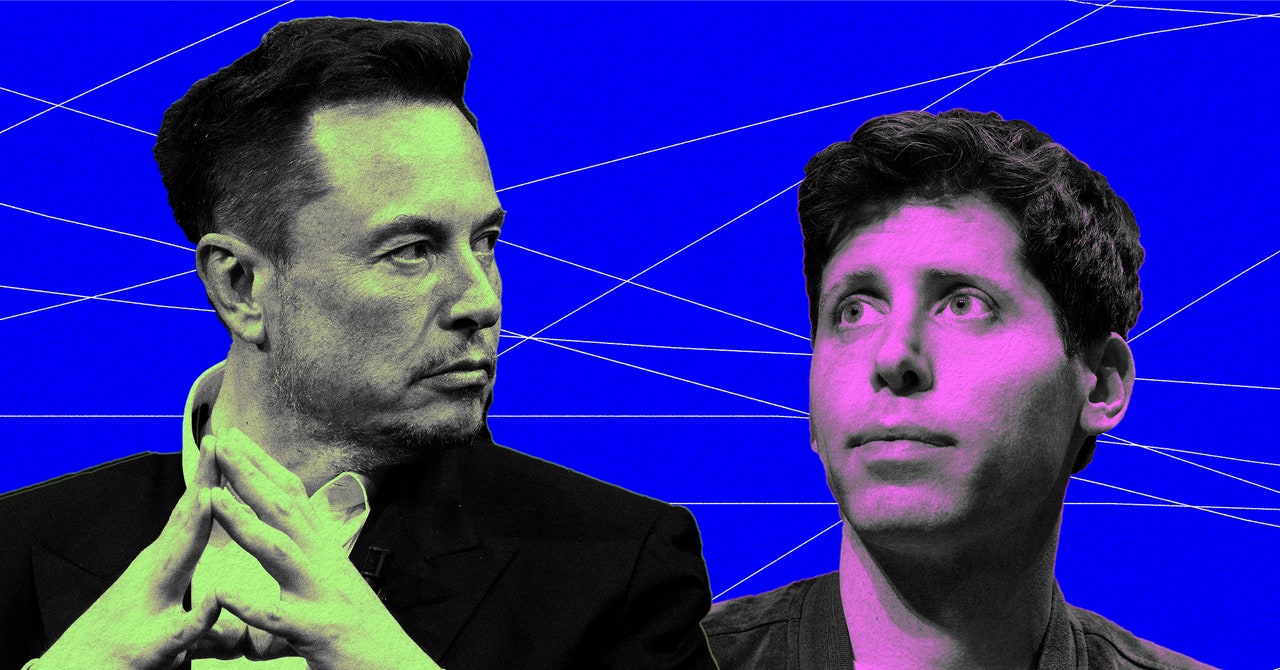

The Wild Claim at the Heart of Elon Musk’s OpenAI Lawsuit

Elon Musk a commencé la semaine en publiant avec tests sur X sur son lutte pour configurer un nouvel ordinateur portable exécutant des fenêtres. Il l'a terminé en déposant une action en justice accusant Openai de développer imprudemment l'IA au niveau humain et de la remettre à Microsoft.

Le procès de Musk est déposé contre Openai et deux de ses dirigeants, le PDG Sam Altman et le président Greg Brockman, qui ont tous deux travaillé avec la fusée et l'entrepreneur en voiture pour fonder la société en 2015. Une grande partie de l'affaire pivotait autour d'une technique audacieuse et douteuse Réclamation: Openai a développé une soi-disant intelligence générale artificielle, ou AGI, un terme généralement utilisé pour désigner les machines qui peuvent faire correspondre ou dépasser de manière globale les humains.

L'affaire affirme qu'Altman et Brockman ont violé le «contrat de fondation» original pour Openai ont travaillé avec Musk, qui, selon lui, a promis à l'entreprise de développer ouvertement AGI et «au profit de l'humanité. La poursuite de Musk allègue que la branche à but lucratif de l'entreprise, établie en 2019 après s'être séparée d'Openai, a plutôt créé AGI sans transparence appropriée et l'a autorisée à Microsoft, qui a investi des milliards dans l'entreprise. Il exige que Openai soit obligé de libérer ouvertement sa technologie et qu'il soit exclu de l'utiliser pour profiter financièrement à Microsoft, Altman ou Brockman.

«Sur l'information et la croyance, GPT-4 est un algorithme AGI», indique le procès, se référant au modèle de grande langue qui se trouve derrière le chatppt d'Openai. Il cite des études qui ont constaté que le système peut obtenir une note de passage à l'examen de barre uniforme et d'autres tests standard comme preuve qu'il a dépassé certaines capacités humaines fondamentales. «GPT-4 n'est pas seulement capable de raisonner. C'est mieux pour raisonner que les humains moyenne », affirme la poursuite.

Bien que le GPT-4 ait été annoncé comme une percée majeure lorsqu'elle a été lancée en mars 2023, la plupart des experts de l'IA ne le voient pas comme une preuve que AGI a été réalisé. «GPT-4 est général, mais ce n'est évidemment pas AGI dans la façon dont les gens utilisent généralement le terme», dit Etzioni Orenprofesseur émérite à l'Université de Washington et expert en IA.

«Il sera considéré comme une affirmation sauvage», dit Christopher Manningprofesseur à l'Université de Stanford qui se spécialise dans l'IA et la langue, de l'affirmation AGI dans le costume de Musk. Manning dit qu'il y a des opinions divergentes de ce qui constitue AGI au sein de la communauté de l'IA. Certains experts pourraient mettre la barre plus bas, faisant valoir que la capacité de GPT-4 à remplir un large éventail de fonctions justifierait l'appeler AGI, tandis que d'autres préfèrent réserver le terme pour les algorithmes qui peuvent déjouer la plupart ou tous les humains à n'importe quoi. «Selon cette définition, je pense que nous n'avons pas très clairement AGI et que nous en sommes encore assez loin», dit-il.

Percée limitée

GPT-4 a gagné un avis – et de nouveaux clients pour OpenAI – car il peut répondre à un large éventail de questions, tandis que les programmes d'IA plus anciens étaient généralement consacrés à des tâches spécifiques comme jouer aux échecs ou marquer des images. Le procès de Musk fait référence aux affirmations des chercheurs de Microsoft, dans un papier À partir de mars 2023, que «compte tenu de l'étendue et de la profondeur des capacités de GPT-4, nous pensons qu'elle pourrait raisonnablement être considérée comme une version précoce (mais toujours incomplète) d'un système d'intelligence générale artificielle (AGI).» Malgré ses capacités impressionnantes, GPT-4 fait toujours des erreurs et a des limites importantes à sa capacité à analyser correctement les questions complexes.

«J'ai le sentiment que la plupart d'entre nous, les chercheurs sur le terrain, pensent que les grands modèles de langue [like GPT-4] sont un outil très significatif pour permettre aux humains de faire beaucoup plus mais qu'ils sont limités de manière à les éloigner des intelligences autonomes », ajoute Michael Jordanprofesseur à UC Berkeley et une figure influente dans le domaine de l'apprentissage automatique.

Jordan ajoute qu'il préfère éviter le terme AGI entièrement parce qu'il est si vague. “Je n'ai jamais trouvé qu'Elon Musk avait quoi que ce soit à dire sur l'IA qui était très calibré ou basé sur la réalité de la recherche”, ajoute-t-il.