Open Source AI Has Founders—and the FTC—Buzzing

Beaucoup de pourparlers d'hier ont été jonchés des acronymes que vous attendez de cet assemblage de panélistes d'esprit: YC, FTC, AI, LLMS. Mais enfilé tout au long des conversations – qui leur a pu, vous pourriez dire – le boostems pour l'IA open source.

C'était un virage à gauche (ou un retour, si vous êtes une tête de Linux) des années 2010 obsédé par l'application, lorsque les développeurs semblaient heureux de conteneuriser leurs technologies et de les remettre à de plus grandes plateformes de distribution.

L'événement s'est également produit deux jours seulement après que le méta-PDG, Mark Zuckerberg, a déclaré que «l'IA open source est le chemin à parcourir» et a publié Llama 3.1, la dernière version de l'algorithme d'IA open source de Meta. Comme Zuckerberg l'a dit dans son annonce, certains technologues ne veulent plus être «contraints par ce que Apple nous permettra de construire» ou de rencontrer des règles arbitraires et des frais d'application.

L'IA open source se trouve également être l'approche Openai est pas Utiliser pour ses plus grands GPT, malgré ce que le nom de la startup de plusieurs milliards de dollars pourrait suggérer. Cela signifie qu'au moins une partie du code est maintenue privée, et Openai ne partage pas les «poids» ou les paramètres de ses systèmes d'IA les plus puissants. Il facture également l'accès au niveau de l'entreprise à sa technologie.

“Avec la montée des systèmes d'IA composés et des architectures d'agent, l'utilisation de modèles open source de petits mais fins donne des résultats nettement meilleurs [OpenAI] Gpt4, ou [Google] Gémeaux. Cela est particulièrement vrai pour les tâches d'entreprise », explique Ali Golshan, cofondateur et directeur général de Gretel.ai, une société de données synthétiques. (Golshan n'était pas à l'événement YC).

«Je ne pense pas que ce soit Openai contre le monde ou quelque chose comme ça», explique Dave Yen, qui dirige un fonds appelé Orange Collective pour que les anciens élèves de YC réussissent pour soutenir les fondateurs de YC émergents. «Je pense qu'il s'agit de créer une concurrence équitable et un environnement où les startups ne risquent pas de mourir le lendemain si OpenAI change leurs modèles de prix ou leurs politiques.»

“Cela ne veut pas dire que nous ne devrions pas avoir de garanties”, a ajouté Yen, “mais nous ne voulons pas non plus les limites inutilement des limites.”

Les modèles d'IA open source présentent des risques inhérents que les technologues plus prudents ont mis en garde – le plus évident étant que la technologie est ouvert et gratuit. Les personnes ayant une intention malveillante sont plus susceptibles d'utiliser ces outils pour le préjudice, ils seraient un modèle d'IA privé coûteux. Les chercheurs ont souligné que c'est bon marché et facile Pour que les mauvais acteurs s'entraînent à tout paramètres de sécurité présents dans ces modèles d'IA.

“Open Source” est également un mythe dans certains modèles d'IA, comme l'a rapporté Kired Knight. Les données utilisées pour les former peuvent toujours être gardées secrètes, leurs licences pourraient empêcher les développeurs de construire certaines choses, et finalement, ils peuvent toujours bénéficier au fabricant de modèles d'origine plus que quiconque.

Et certains politiciens ont repoussé le développement sans entrave de systèmes d'IA à grande échelle, notamment le sénateur de l'État de Californie Scott Wiener. Le projet de loi sur la sécurité et l'innovation de l'IA de Wiener, SB 1047, a été controversé dans les cercles technologiques. Il vise à établir des normes pour les développeurs de modèles d'IA qui coûtent plus de 100 millions de dollars pour s'entraîner, nécessitent certains niveaux de tests de sécurité préalable au déploiement et d'équipement rouge, protège les dénonciateurs travaillant dans des laboratoires d'IA et accordent le recours juridique du procureur général de l'État si une IA Le modèle cause un préjudice extrême.

Wiener lui-même a pris la parole lors de l'événement YC jeudi, dans une conversation animée par le journaliste de Bloomberg, Shirin Ghaffary. Il a dit qu'il était «profondément reconnaissant» aux gens de la communauté open source qui se sont prononcés contre le projet de loi, et que l'État a «fait une série d'amendements en réponse directe à certains de ces commentaires critiques». Un changement qui a été apporté, a déclaré Wiener, est que le projet de loi définit désormais plus clairement un chemin raisonnable pour fermer un modèle d'IA open source qui a quitté les rails.

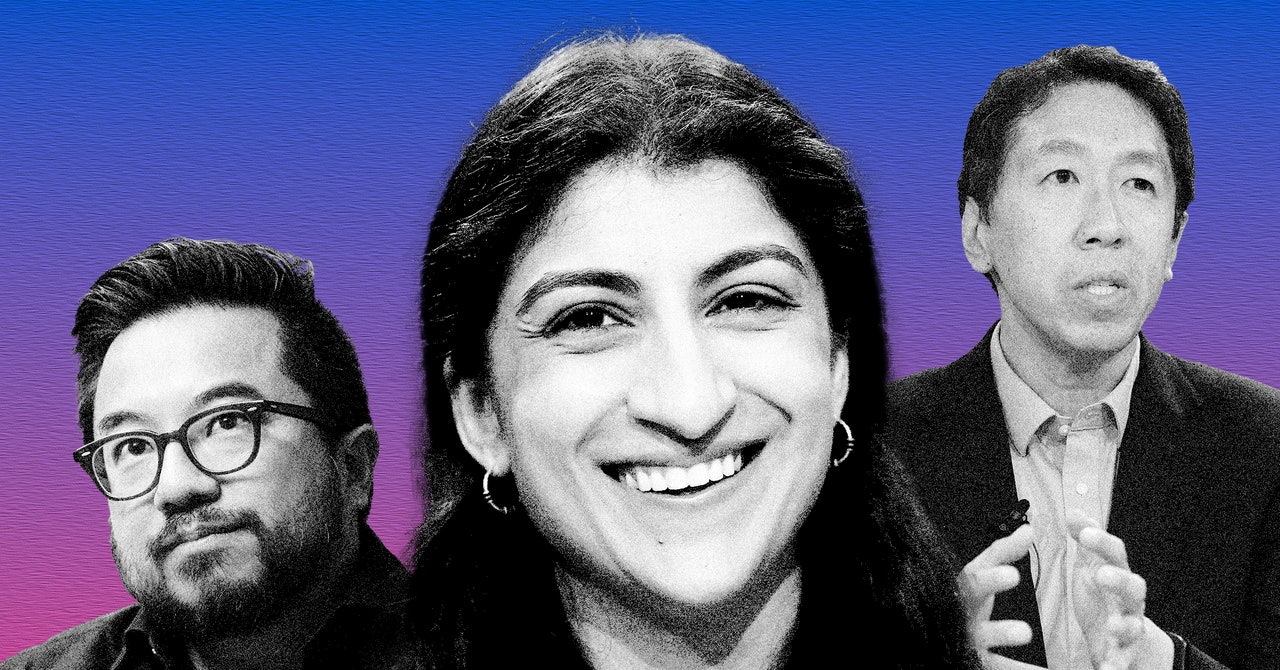

Le président de célébrité de l'événement de jeudi, ajout de dernière minute au programme, était Andrew Ng, cofondateur de Coursera, fondateur de Google Brain, et ancien scientifique en chef de Baidu. NG, comme beaucoup d'autres personnes présentes, a pris la parole pour défendre les modèles open source.

«C'est l'un de ces moments où [it’s determined] Si les entrepreneurs sont autorisés à continuer d'innover », a déclaré Ng,« ou si nous devrions dépenser l'argent qui irait à la construction de logiciels sur l'embauche d'avocats. »