New US Rule Aims to Block China’s Access to AI Chips and Models by Restricting the World

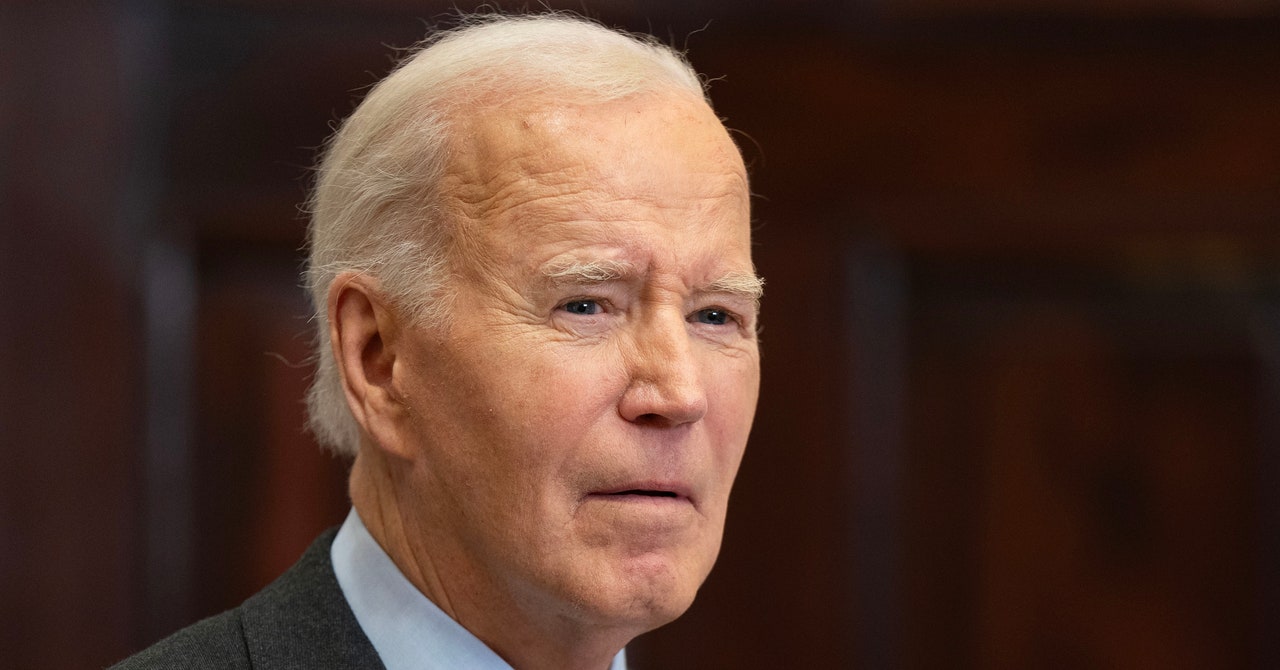

L’administration Biden a annoncé aujourd’hui un nouveau système de contrôle des exportations audacieux et controversé, conçu pour empêcher les puces avancées et les modèles d’intelligence artificielle eux-mêmes de se retrouver entre les mains d’adversaires tels que la Chine.

La nouvelle « règle de diffusion de l'IA » de l'administration divise le monde entre les nations qui ont un accès relativement illimité au silicium et aux algorithmes d'IA les plus avancés d'Amérique, et celles qui nécessiteront des licences spéciales pour accéder à la technologie. La règle, qui sera appliquée par le Bureau de l'industrie et de la sécurité du ministère du Commerce, vise également pour la première fois à restreindre le mouvement des modèles d'IA les plus puissants.

“Les États-Unis sont désormais à la pointe du monde en matière d'IA, tant dans le développement de l'IA que dans la conception de puces, et il est essentiel que cela reste ainsi”, a déclaré la secrétaire américaine au Commerce, Gina Raimondo, avant l'annonce d'aujourd'hui.

La liste des pays de confiance comprend le Royaume-Uni, le Canada, l'Australie, le Japon, la France, l'Allemagne, la Belgique, le Danemark, la Finlande, l'Irlande, l'Italie, les Pays-Bas, la Nouvelle-Zélande, la Norvège, la République de Corée, l'Espagne, la Suède et Taiwan.

Les entreprises d’autres pays non soumis au contrôle des armements pourront obtenir jusqu’à 1 700 des dernières puces d’IA sans autorisation spéciale, indique la règle. Ils pourront demander une licence spéciale pour acquérir davantage de puces, pour construire des centres de données à très grande échelle utilisant la technologie américaine ou pour accéder aux « poids » de modèle fermé les plus puissants fabriqués par des entreprises américaines. Les entreprises devront disposer d’une sécurité physique et cybersécurité adéquate pour obtenir une licence.

Les activités de la chaîne d’approvisionnement, notamment la conception, la fabrication et le stockage des puces, seront exemptées de cette règle. La règle ne limitera pas non plus les modèles d'IA open source tels que Meta's Llama, indique l'administration.

Les pays soumis à un embargo sur les armes, comme la Chine, l’Iran et la Corée du Nord, n’ont déjà pas le droit d’obtenir des puces avancées. La nouvelle règle restreindra pour la première fois leur accès aux modèles avancés.

« Les semi-conducteurs qui alimentent [AI] et les poids des modèles sont, comme nous le savons tous, une technologie à double usage », a ajouté Raimondo avant l'annonce. “Ils sont utilisés dans de nombreuses applications commerciales, mais peuvent également être utilisés par nos adversaires pour effectuer des simulations nucléaires, développer des armes biologiques et faire progresser leurs armées.”

Cependant, cette règle suscitera certainement la controverse, car elle pourrait freiner les ventes internationales d’IA à un moment critique pour l’industrie. Cela arrive à peine une semaine avant l’investiture de Donald Trump. La décision fixe une période de consultation de 120 jours, ce qui signifie que l'administration Trump devra écouter les commentaires, peut-être modifier la règle, puis l'appliquer.

Nvidia, le premier fabricant mondial de puces IA, a qualifié cette règle de « sans précédent et peu judicieuse » dans son rapport. un article de blog. «Bien qu'elles soient dissimulées sous le couvert d'une mesure 'anti-Chine', ces règles ne contribueraient en rien à renforcer la sécurité des États-Unis. Plutôt que d'atténuer toute menace, les nouvelles règles de Biden ne feraient qu'affaiblir la compétitivité mondiale des États-Unis, sapant ainsi l'innovation qui a permis aux États-Unis de garder une longueur d'avance.»

Les États-Unis limitent déjà les exportations de puces d’IA avancées vers la Chine, un rival géopolitique majeur, mais les entreprises de ce pays ont pu créer des algorithmes de découpe à l’aide de clusters informatiques situés dans d’autres pays. En vertu de la nouvelle règle, la Chine ne sera pas en mesure de construire des modèles d’IA dits frontières dans d’autres pays touchés par la règle.