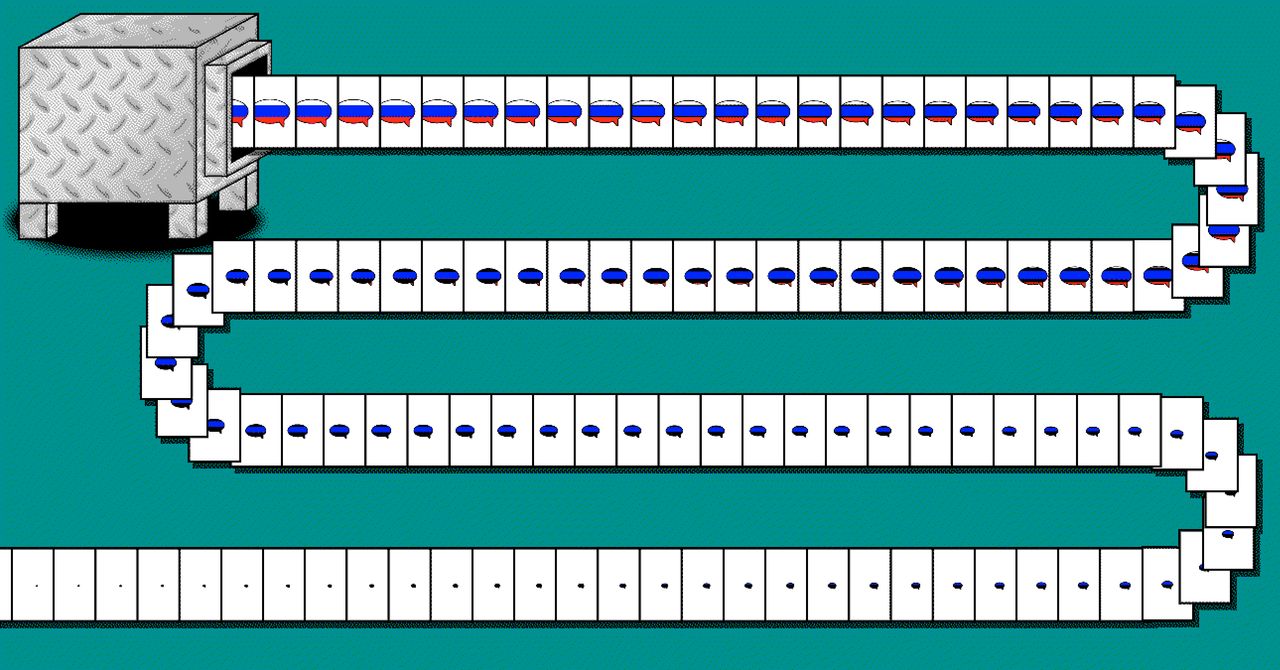

It Costs Just $400 to Build an AI Disinformation Machine

Renee a été restauréeresponsable de la recherche technique pour l'Observatoire Internet de Stanford, qui suit les campagnes d'information, affirme que les articles et les profils de journalistes générés dans le cadre du projet Counter-Cloud sont assez convaincants.

«En plus des acteurs gouvernementaux, des agences de gestion des médias sociaux et des mercenaires qui offrent des services d'influence sur les opérations prendront sans aucun doute ces outils et les intégreront dans leurs flux de travail», explique Diresta. Obtenir un faux contenu largement distribué et partagé est difficile, mais cela peut être fait en payant des utilisateurs influents pour le partager, ajoute-t-elle.

Certaines preuves de campagnes de désinformation en ligne propulsées par l'IA ont déjà fait surface. Les chercheurs universitaires ont récemment découvert un botnet brut et crypto apparemment propulsé par le chatppt. L'équipe a déclaré que la découverte suggère que l'IA derrière le chatbot est probablement déjà utilisée pour des campagnes d'information plus sophistiquées.

Les campagnes politiques légitimes se sont également tournées vers l'utilisation de l'IA avant l'élection présidentielle américaine de 2024. En avril, le Comité national républicain a produit une vidéo Attaquant Joe Biden qui comprenait de fausses images générées par l'AI-AI. Et en juin, un compte de médias sociaux associé à Ron Desantis comprenait des images générées par l'AI une vidéo destiné à discréditer Donald Trump. La Commission électorale fédérale a déclaré qu'elle pourrait limiter l'utilisation de Fakews dans les publicités politiques.

Micah Musserun chercheur qui a étudié le potentiel de désinformation des modèles linguistiques de l'IA, s'attend à ce que les campagnes politiques traditionnelles essaient d'utiliser des modèles linguistiques pour générer du contenu promotionnel, des e-mails de collecte de fonds ou des annonces d'attaque. «C'est une période totalement fragile en ce moment où il n'est pas vraiment clair quelles sont les normes», dit-il.

Beaucoup de texte généré par l'AI-AI reste assez générique et facile à repérer, dit Musser. Mais le fait que le contenu généré par les humains soit généré par les humains poussant la désinformation pourrait être très efficace et presque impossible à cesser d'utiliser des filtres automatisés, dit-il.

Le PDG d'Openai, Sam Altman, dit dans un tweet le mois dernier qu'il craint que l'intelligence artificielle de son entreprise ne soit utilisée pour créer une désinformation automatisée sur mesure à grande échelle.

Lorsque OpenAI a rendu sa technologie de génération de texte disponible via une API, elle a interdit toute utilisation politique. Cependant, en mars, la société a mis à jour sa politique pour interdire l'utilisation visant à produir de masse pour une démographie particulière. Un récent Washington Post article suggérer Ce GPT ne bloque pas lui-même la génération de ces matériaux.

Kim Malfacini, responsable de la politique des produits à Openai, affirme que la société explore comment sa technologie de génération de texte est utilisée à des fins politiques. Les gens ne sont pas encore habitués à supposer que le contenu qu'ils voient peut être généré par l'AI, dit-elle. «Il est probable que l'utilisation d'outils d'IA dans un certain nombre d'industries ne fera que croître, et la société mettra à jour à cela», explique Malfacini. “Mais pour le moment, je pense que les gens sont toujours en train de mettre à jour.”

Étant donné qu'une multitude d'outils d'IA similaires sont désormais largement disponibles, notamment modèles open source Cela peut être construit avec quelques restrictions, les électeurs devraient être sages à l'utilisation de l'IA en politique le plus tôt possible.